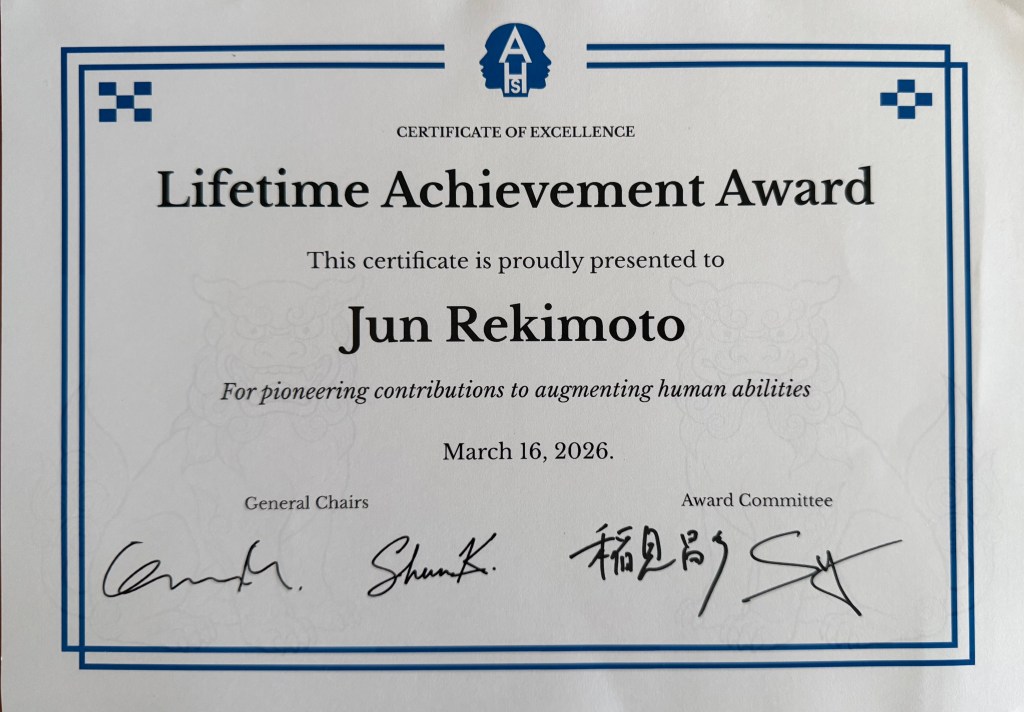

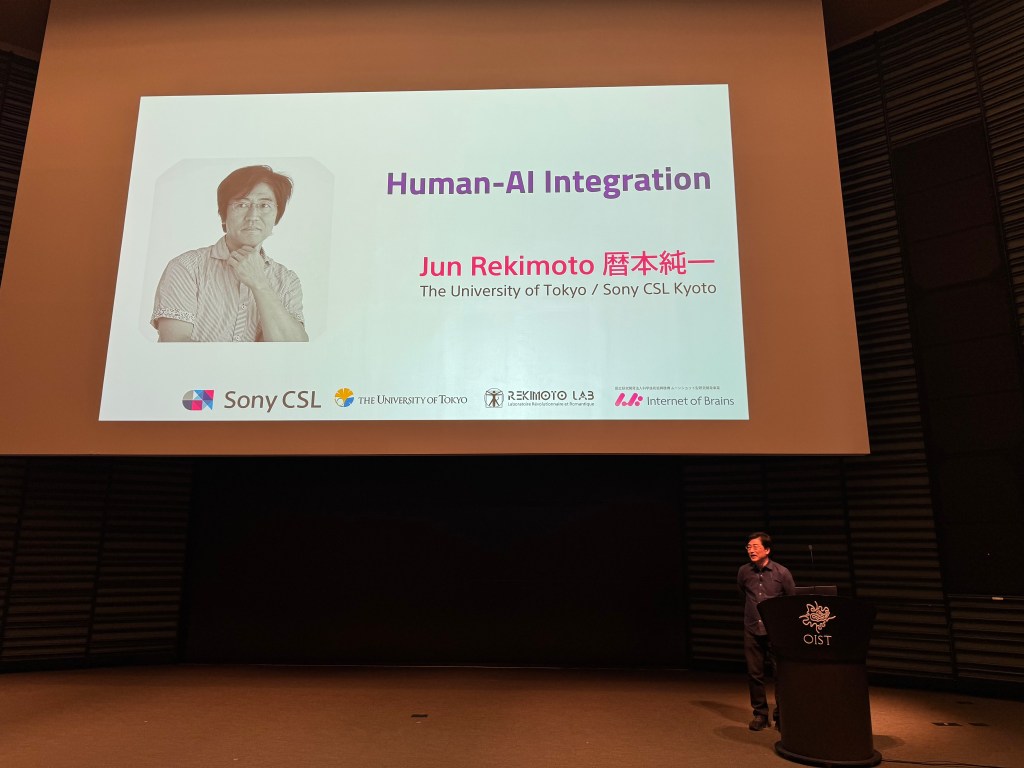

2026年3月に沖縄ので開催された国際会議「Augmented Humans International Conference 2026 (AHs ’26)」において、当研究室の暦本純一先生が、最高栄誉である「Lifetime Achievement Award(生涯功労賞)」を受賞されました。

この賞は、長年にわたり人間の能力拡張(Human Augmentation)および関連分野における先駆的かつ多大なる貢献を果たした研究者に授与されるものです。暦本先生のこれまでのビジョナリーな研究活動が世界的に高く評価されました。

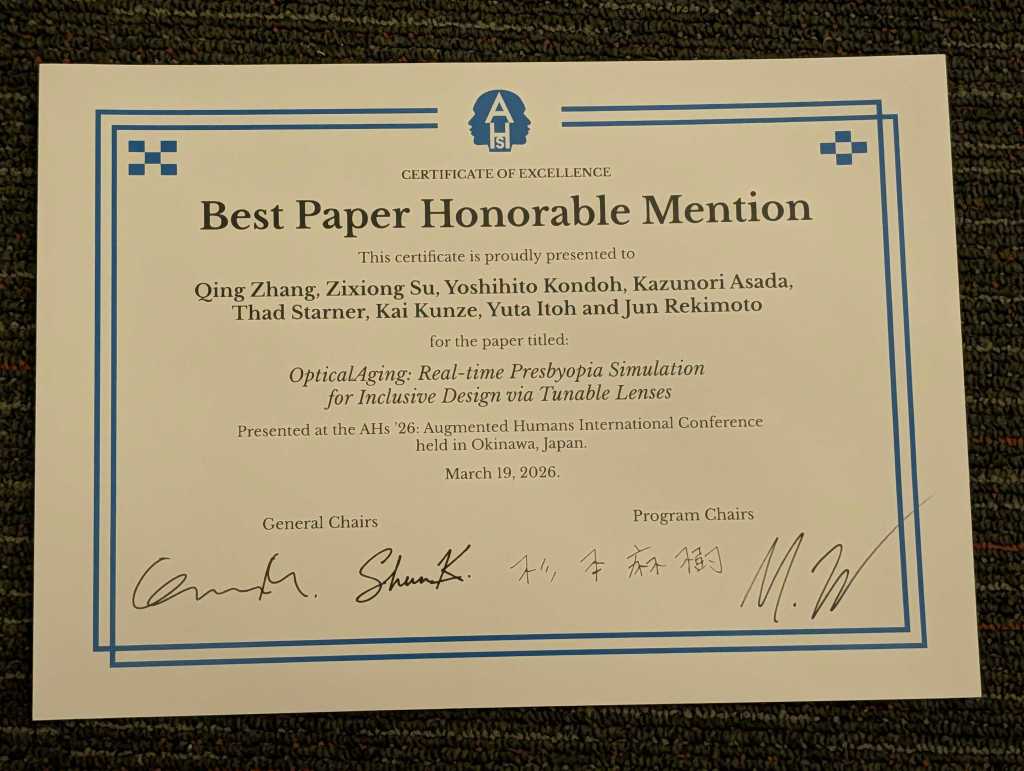

さらに、当研究室の特任助教の張清が執筆した論文が、同会議にて「Best Paper Honorable Mention」に選出されました。

受賞論文名:

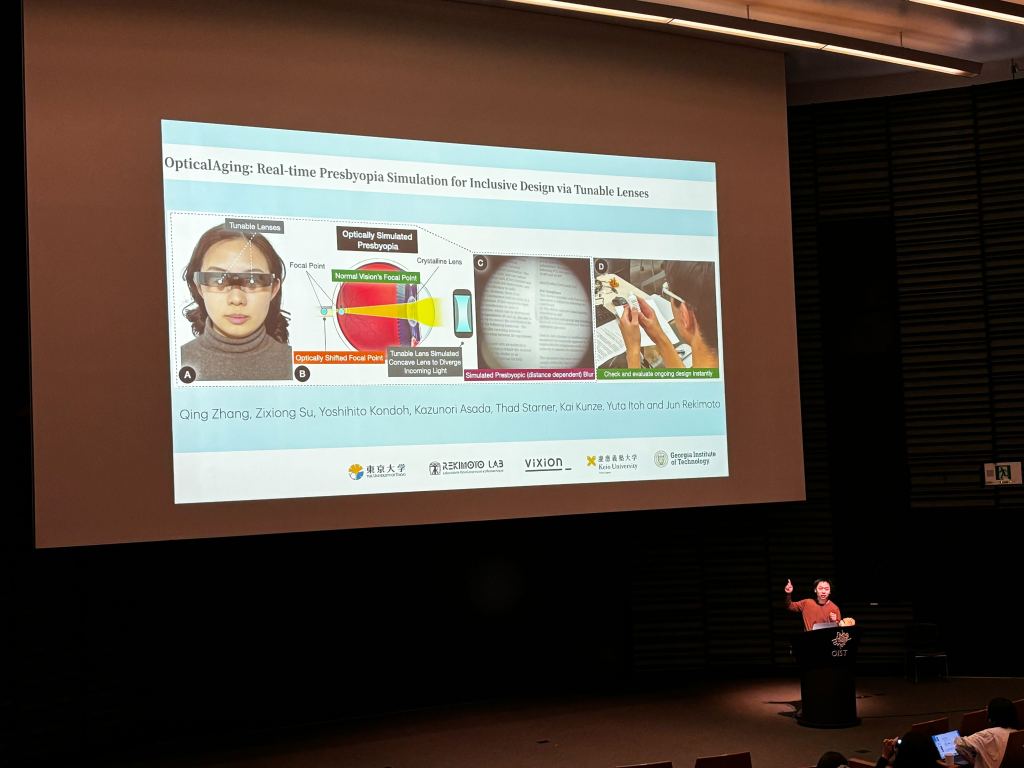

OpticalAging: Real-time Presbyopia Simulation for Inclusive Design via Tunable Lenses

著者リスト:

Qing Zhang, Zixiong Su, Yoshihito Kondoh, Kazunori Asada, Thad Starner, Kai Kunze, Yuta Itoh and Jun Rekimoto

本研究は、可変焦点レンズを用いて、加齢に伴う老眼(老視)の視覚体験をリアルタイムにシミュレーションするシステム「OpticalAging」を開発したものです。これにより、インクルーシブな製品設計や環境評価を容易にし、超高齢社会におけるQOL向上に貢献します。

ーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーーー

Professor Jun Rekimoto Honored with the “Lifetime Achievement Award” at Augmented Humans 2026! Our Research Group Also Secured a “Best Paper Honorable Mention.”

We are pleased to announce that Professor Jun Rekimoto of our lab received the prestigious “Lifetime Achievement Award” at the Augmented Humans International Conference 2026 (AHs ’26), held in Okinawa, Japan, in March 2026.

This award is presented to individuals who have made pioneering and significant contributions to the field of Human Augmentation and related disciplines over many years. Professor Rekimoto’s visionary research work was highly recognized globally.

Furthermore, a paper lead-authored by our lab’s Assistant Professor, QING ZHANG, received the “Best Paper Honorable Mention” at the same conference.

Awarded Paper Title:

OpticalAging: Real-time Presbyopia Simulation for Inclusive Design via Tunable Lenses

Author List:

Qing Zhang, Zixiong Su, Yoshihito Kondoh, Kazunori Asada, Thad Starner, Kai Kunze, Yuta Itoh and Jun Rekimoto

This research introduced “OpticalAging,” a system using tunable lenses to simulate presbyopia (age-related farsightedness) in real-time. This technology facilitates inclusive product design and environmental assessment, contributing to the improvement of QOL in super-aging societies.

You must be logged in to post a comment.